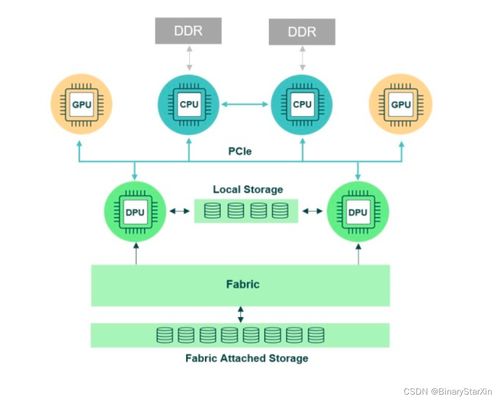

隨著云計算、人工智能和大數據應用的爆炸式增長,數據中心正面臨著前所未有的數據處理壓力。傳統的以CPU為中心的架構在處理海量網絡數據、存儲I/O和復雜的安全協議時,逐漸顯露出性能瓶頸和效率不足。在此背景下,數據處理單元(Data Processing Unit, DPU) 應運而生,并迅速成為現代數據中心不可或缺的核心組件。

一、傳統架構的瓶頸:CPU不堪重負

在傳統的數據中心架構中,CPU承擔了絕大部分的計算任務,包括應用計算、網絡數據包處理、存儲虛擬化、安全加密以及系統管理等。隨著網絡速度從10GbE、25GbE向100GbE甚至400GbE邁進,以及NVMe存儲的普及,這些“基礎設施任務”消耗的CPU核心周期越來越多。研究表明,在一個高性能的云服務器中,高達30%甚至更多的CPU資源被用于運行網絡、存儲和安全堆棧,而非用戶的核心業務應用。這導致了巨大的資源浪費和總擁有成本(TCO)的上升。

二、DPU的定義與核心能力

DPU是一種專為數據中心基礎設施任務設計的片上系統(SoC)。它通常集成了三個關鍵部分:

- 高性能多核處理器:通常基于Arm架構,用于運行控制面和數據面軟件。

- 高性能網絡接口:支持高帶寬、低延遲的RDMA(遠程直接內存訪問)和智能網絡卸載。

- 靈活的加速引擎:通過硬件或可編程邏輯(如FPGA)對存儲、安全、虛擬化等任務進行硬件加速。

其核心思想是 “基礎設施卸載與加速” ,將CPU從繁重的底層任務中解放出來,使其專注于運行商業應用和業務邏輯。

三、數據中心需要DPU的五大核心原因

1. 提升整體性能與效率

DPU通過硬件卸載網絡協議棧(如TCP/IP)、存儲虛擬化(如NVMe-oF)和加密解密(如TLS/IPsec)等任務,能大幅降低處理延遲并提高吞吐量。CPU得以將全部算力用于產生直接價值的應用計算,從而提升了整個服務器乃至數據中心的效率。

2. 降低總擁有成本(TCO)

從經濟角度看,CPU核心是非常昂貴的計算資源。將基礎設施任務卸載到更具能效比的DPU上,意味著可以用更少的CPU服務器完成相同的工作負載,或者在相同數量的服務器上支持更多的虛擬機或容器。這直接降低了硬件采購成本和數據中心的空間、電力消耗。

3. 增強安全性與隔離性

DPU可以作為數據中心內部的“可信根”和安全網關。它能夠在硬件層面實現安全啟動、信任根、密鑰管理以及防火墻功能。更重要的是,DPU可以在物理硬件和上層虛擬機/容器之間建立一個強大的、由硬件強化的安全隔離層(“零信任”架構的關鍵),即使宿主機被攻破,也能保護網絡和存儲數據的安全。

4. 實現真正的“可組合式基礎設施”

現代數據中心正朝著云原生和可組合架構演進。DPU是實現這一愿景的基石。它能夠對服務器底層的計算、存儲和網絡資源進行抽象、池化和靈活調配。通過DPU,管理員可以像分配軟件一樣動態地分配硬件資源,為每個應用提供定制化的硬件服務級別協議(SLA),極大地提升了資源利用率和運維敏捷性。

5. 應對云原生與微服務的挑戰

微服務架構帶來了密集的東西向網絡流量(服務間通信)。DPU能夠智能地處理這種流量,實現服務網格的硬件加速(如服務發現、負載均衡、加密通信),大幅減輕服務網格代理對CPU的消耗,使微服務應用運行得更快、更高效。

四、應用場景示例

- 超融合基礎設施(HCI):DPU卸載存儲和網絡虛擬化,釋放CPU資源,使HCI集群在提供相同性能時所需節點數更少。

- 公有云與裸金屬服務:云服務商通過DPU提供高性能、安全的網絡和存儲服務,同時確保多租戶之間的強隔離。

- 人工智能/機器學習訓練:在分布式AI訓練中,DPU可以加速GPU服務器之間的高速通信(如NVIDIA的GPUDirect RDMA),減少數據交換瓶頸。

- 5G邊緣計算:在空間和功耗受限的邊緣數據中心,高集成度、低功耗的DPU是實現網絡功能虛擬化(NFV)和邊緣應用高效運行的關鍵。

###

DPU的出現并非要取代CPU或GPU,而是與它們協同工作,共同構成數據中心計算的“鐵三角”(CPU-通用計算,GPU-加速計算,DPU-基礎設施處理)。它標志著數據中心架構從“以計算為中心”向“以數據為中心”的深刻轉變。通過將基礎設施任務專業化、硬件化,DPU正在成為釋放CPU潛力、提升數據中心整體效能、保障安全與實現敏捷創新的核心引擎。對于任何追求高性能、高效率和現代化架構的數據中心而言,集成DPU已從一種前瞻性選擇,轉變為一種必然趨勢。